¿Es ChatGPT realmente tan consumidor de energía? 🔋🌍

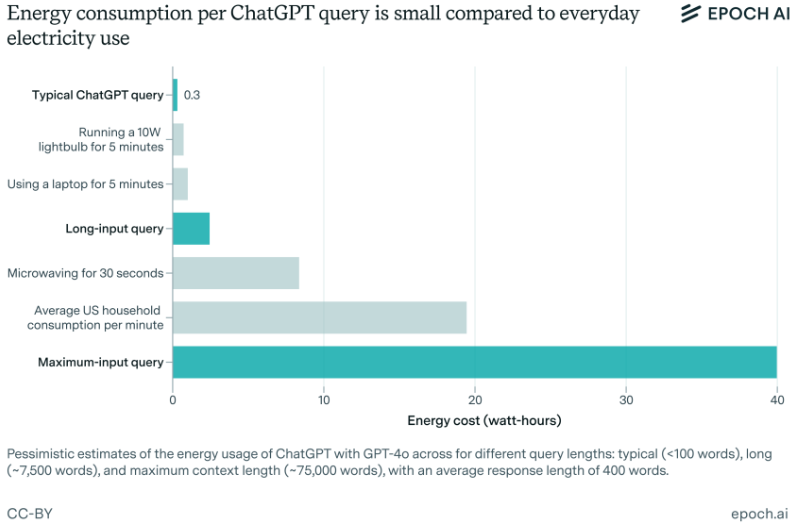

Un nuevo estudio de Epoch AI sugiere que ChatGPT usa menos energía de lo que se pensaba. Mientras que se estimaba que consumía 3 vatios-hora por consulta (10 veces más que una búsqueda en Google), el análisis indica que el consumo real es de 0.3 vatios-hora en promedio.

📉 Principales hallazgos:

✅ ChatGPT consume menos energía que muchos electrodomésticos.

🔍 Estimaciones previas usaban datos de chips más antiguos y menos eficientes.

🚀 Modelos de IA futuros serán más avanzados, pero requerirán más energía.

💡 ¿Qué significa esto para el futuro?

🖥️ Centros de datos de IA podrían necesitar la capacidad total de energía de California en 2022.

🤖 Modelos de “razonamiento” como GPT-4o-mini son más eficientes, pero siguen aumentando la demanda energética.

🔄 Se recomienda usar IA con moderación o modelos más pequeños para reducir el impacto.

📌 Fuente: TechCrunch